Chia sẻ bởi Nate Herk

Trong thời đại số hóa, việc tự động hóa sản xuất nội dung không còn là giấc mơ xa vời. Hãy tưởng tượng bạn có một "bản sao AI" của chính mình, sẵn sàng tạo video bất cứ lúc nào mà bạn không cần phải xuất hiện trước ống kính. Tôi đã dày công xây dựng và thử nghiệm một quy trình tự động hóa mạnh mẽ sử dụng HeyGen và n8n, và hôm nay, tôi sẽ chia sẻ cặn kẽ từng bước để bạn có thể nhân bản thành công này. Với hệ thống này, việc nhân 10, thậm chí 20 lần sản lượng nội dung mà không tốn thêm công sức là hoàn toàn khả thi. Cùng khám phá bí mật đằng sau nhé!

Tại sao phải "dấn thân" vào tự động hóa nội dung với AI clone?

Trước khi "mổ xẻ" các chi tiết kỹ thuật, hãy cùng làm rõ tại sao AI clone lại là một cuộc cách mạng trong sản xuất nội dung. Thay vì ngốn hàng giờ đồng hồ cho việc quay phim, biên tập, rồi đăng tải, bạn hoàn toàn có thể "ủy thác" cho AI. Một avatar AI được cá nhân hóa bằng chính giọng nói của bạn không chỉ giúp giải phóng thời gian mà còn đảm bảo sự chân thực và dấu ấn cá nhân trong từng sản phẩm. Hơn thế nữa, khi kết hợp với "bộ não" tự động hóa n8n, bạn có thể thiết lập một dây chuyền sản xuất video tự động từ kịch bản lấy từ tin tức nóng hổi, xu hướng mạng xã hội, hay bất kỳ nguồn dữ liệu nào bạn muốn. Đây chính là bí quyết giúp tôi mở rộng quy mô sản xuất nội dung một cách ngoạn mục.

Bước khởi đầu cùng HeyGen: "Đúc" Avatar và "luyện" giọng nói AI của riêng bạn

1. Đăng ký và "làm quen" HeyGen

HeyGen là một nền tảng đột phá, cho phép bạn tạo avatar AI và nhân bản giọng nói mà không đòi hỏi bất kỳ kỹ năng lập trình nào. Để bắt đầu, bạn chỉ cần truy cập trang chủ của HeyGen và tạo một tài khoản. Gói miễn phí ban đầu là đủ để bạn trải nghiệm các tính năng cốt lõi. Sau khi đăng ký, HeyGen sẽ có những hướng dẫn trực quan giúp bạn nhanh chóng làm quen với giao diện.

2. "Chất liệu vàng": Quay video tạo avatar

Để tạo một avatar AI "giống như tạc", HeyGen cần bạn cung cấp một đoạn video gốc dài từ 2 đến 5 phút. Trong video này, hãy nhìn thẳng vào camera, nói chuyện một cách tự nhiên và thoải mái sử dụng cử chỉ tay. Một bí quyết nhỏ tôi học được là hãy diễn tả cảm xúc "lố" hơn một chút để avatar của bạn thêm phần sống động. Bạn có thể nói về bất cứ điều gì, miễn là giọng điệu tự nhiên và mạch lạc. Sau đó, bạn sẽ cần ghi một đoạn thông điệp ngắn để xác nhận quyền sử dụng hình ảnh của mình.

Khi tôi thực hiện, chỉ mất khoảng 30 giây để quay một video ngắn giới thiệu bản thân, kết hợp với cử chỉ tay. Video này sau đó được tải lên HeyGen. Quá trình xử lý thường khá nhanh chóng, và bạn sẽ nhận được thông báo khi avatar sẵn sàng.

3. "Diện kiến" và tinh chỉnh avatar

Khi avatar hoàn thành, bạn có thể đặt tên và chiêm ngưỡng "bản sao" của mình. Tôi thực sự ấn tượng với độ chân thực của avatar – nó nói chuyện và cử động gần như y hệt tôi. HeyGen cũng tự động nhân bản giọng nói của bạn từ video đã cung cấp. Nếu bạn đã sở hữu một giọng nói nhân bản từ các nền tảng khác như ElevenLabs, bạn hoàn toàn có thể tích hợp vào HeyGen. Khi mọi thứ đã hoàn hảo, avatar và giọng nói này sẽ sẵn sàng để bạn truy cập thông qua API và đưa vào guồng máy tự động hóa.

"Kiến trúc sư" tự động hóa: Thiết lập Workflow với n8n

1. n8n là gì? Tại sao lại là n8n?

n8n là một công cụ tự động hóa mã nguồn mở, linh hoạt, cho phép bạn kết nối hàng loạt ứng dụng và dịch vụ để tạo ra các quy trình tự động phức tạp mà không cần viết code. Trong dự án này, n8n đóng vai trò trung tâm, giao tiếp với API của HeyGen để tự động hóa việc tạo video từ avatar. Điều tuyệt vời là bạn không cần phải là một lập trình viên – chỉ cần hiểu logic và cách các "node" (nút) trong n8n tương tác với nhau.

2. "Bắt tay" HeyGen API và n8n: Thiết lập ban đầu

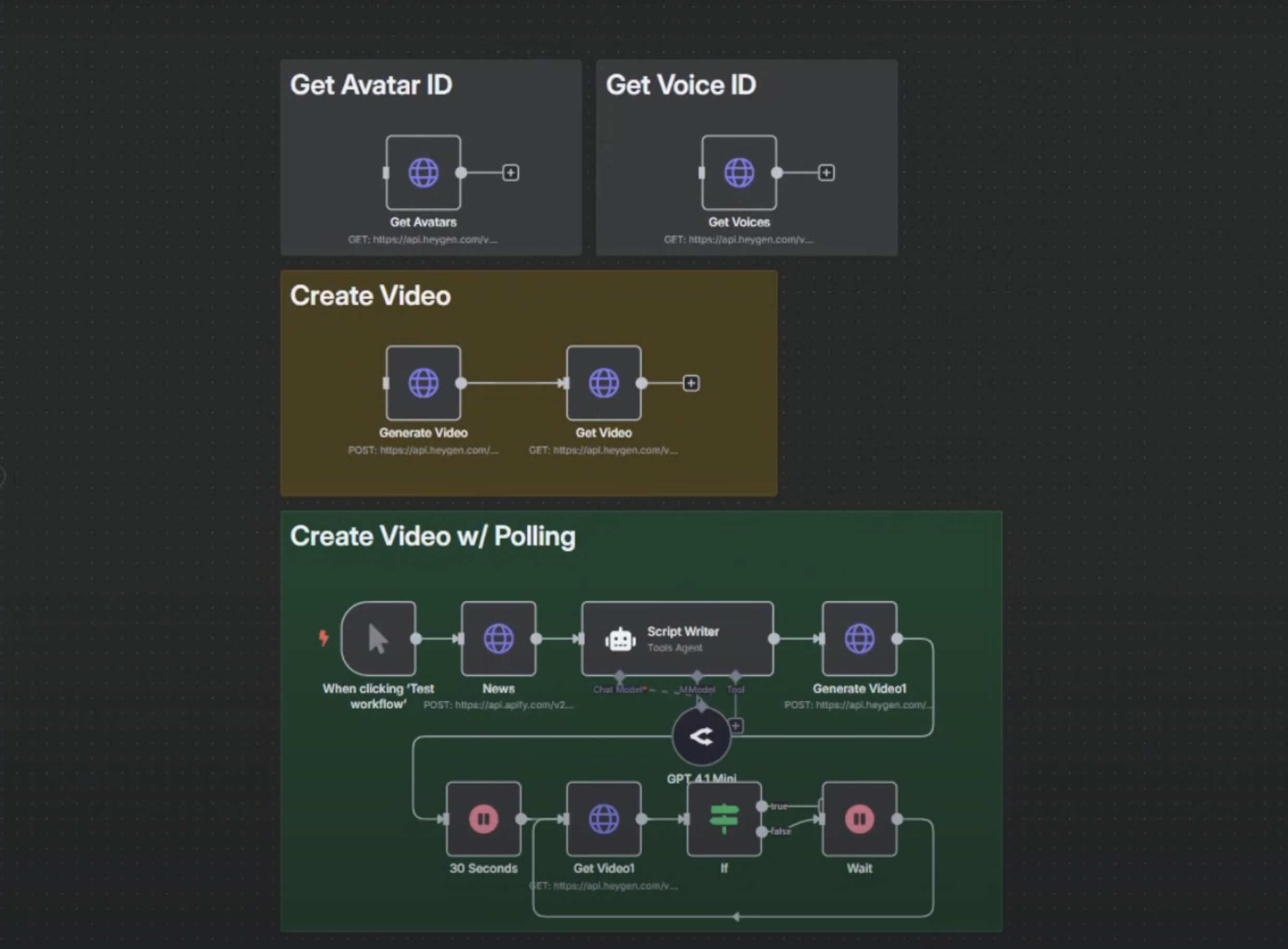

Trong n8n, hãy tạo một workflow mới. Workflow HeyGen_Avatar.json bao gồm các node chính sau:

- Trigger: Bắt đầu bằng một node

When clicking ‘Test workflow’(Manual Trigger) để bạn có thể tự kích hoạt quy trình khi cần kiểm tra. - Kết nối API HeyGen:

- Bạn cần lấy API key từ tài khoản HeyGen của mình.

- Trong n8n, các node

HTTP Requestsẽ được sử dụng để giao tiếp với HeyGen. Với các node nhưGenerate Video,Get Video,Get Avatars, vàGet Voices, bạn cần thiết lập xác thực. Chọn "Authentication" làGeneric Credential Type, sau đó "Generic Auth Type" làHttpHeaderAuth. Tại đây, bạn sẽ thêm API key của HeyGen vào phần header ('X-Api-Key: ').

3. "Truy tìm" Avatar ID và Voice ID

Để HeyGen biết bạn muốn sử dụng avatar và giọng nói nào, bạn cần cung cấp ID tương ứng của chúng.

- Cách thủ công: Đăng nhập HeyGen, vào mục quản lý avatar và giọng nói, rồi sao chép ID.

- Cách tự động với n8n: Workflow đã có sẵn các node

Get Avatars(gửi GET request tớihttps://api.heygen.com/v2/avatars) vàGet Voices(gửi GET request tớihttps://api.heygen.com/v2/voices). Các node này sẽ lấy về danh sách tất cả avatar và giọng nói cùng ID của chúng, giúp bạn dễ dàng chọn lựa hoặc tự động hóa việc chọn ID.

4. "Thổi hồn" cho Avatar: Tạo video tự động từ kịch bản

Node Generate Video là nơi điều kỳ diệu xảy ra. Đây là một HTTP POST request đến endpoint https://api.heygen.com/v2/video/generate của HeyGen.

- Cấu hình Body: Trong phần body của request (dưới dạng JSON), bạn sẽ chỉ định:

avatar_id: ID của avatar bạn muốn sử dụng (thay thế "avatar_id" placeholder).voice_id: ID của giọng nói bạn muốn sử dụng (thay thế "voice_id" placeholder).input_text: Đây chính là kịch bản mà avatar sẽ nói. Ví dụ trong JSON là "Hey AI Automation Society Family. You guys rock.".dimension: Kích thước video (ví dụ: width 1280, height 720).

- Sau khi gửi request, HeyGen sẽ trả về một

video_idtrong phầndatacủa JSON response.video_idnày rất quan trọng để kiểm tra trạng thái và lấy video thành phẩm.

Xây dựng "dây chuyền sản xuất" video tự động hoàn chỉnh

Quy trình trong file JSON của bạn mô tả một hệ thống tự động hóa tinh vi, đặc biệt là luồng "Create Video w/ Polling":

1. Lấy tin tức tự động với Apify

- Quy trình bắt đầu từ node

When clicking ‘Test workflow’kích hoạt nodeNews. - Node

Newslà một HTTP Request đến API của Apify (https://api.apify.com/v2/acts/apify~website-content-crawler/run-sync-get-dataset-items). - Nó được cấu hình để crawl trang

https://www.morningbrew.com/issues/latestvà lưu nội dung dưới dạng Markdown ("saveMarkdown": true). Bạn cần kết nối Apify token của mình vào node này theo hướng dẫn trong "Sticky Note5".

2. "Chắp bút" kịch bản thông minh với AI (Langchain & OpenRouter)

- Dữ liệu văn bản (Markdown) từ node

Newsđược chuyển đến nodeScript Writer. - Node

Script Writerlà mộtn8n-nodes-langchain.agentđược thiết kế để tạo kịch bản video ngắn (10-20 giây, 40-60 từ) tóm tắt 2-4 tin tức quan trọng nhất từ nội dung Morning Brew. Nó có một system prompt chi tiết để định hướng AI. - Node này được kết nối với một Language Model là

GPT 4.1 Mini(noden8n-nodes-langchain.lmChatOpenRouter), sử dụng dịch vụ OpenRouter. Bạn cần kết nối API key OpenRouter của mình vào.

3. Tạo video HeyGen với kịch bản AI

- Kịch bản từ

Script Writersẽ được đưa vào nodeGenerate Video1. Node này tương tự nodeGenerate Videođã mô tả ở trên, nhưng sử dụng kịch bản động từ AI.- Bạn cần đảm bảo

input_texttrong nodeGenerate Video1được thiết lập để lấy dữ liệu từ đầu ra của nodeScript Writer(ví dụ:{{ $('Script Writer').item.json.text }}).

- Bạn cần đảm bảo

4. Kiên nhẫn chờ đợi và kiểm tra trạng thái Video (Polling)

Việc tạo video không diễn ra ngay lập tức. Workflow đã có sẵn một cơ chế polling thông minh:

- Sau khi

Generate Video1gửi yêu cầu, quy trình đi tới node30 Seconds(Wait node), tạm dừng 10-30 giây (Lưu ý: bạn có thể sửa tham sốamount: 10trong JSON thành thời gian mà bạn muốn). - Tiếp theo, node

Get Video1sẽ được kích hoạt. Node này gửi GET request đếnhttps://api.heygen.com/v1/video_status.getvớivideo_idlấy từ output củaGenerate Video1(cụ thể là{{ $('Generate Video1').item.json.data.video_id }}) để kiểm tra trạng thái video. - Node

Ifsau đó kiểm tra xem{{ $json.data.status }}có bằng "completed" hay không.- Nếu TRUE (video đã hoàn thành), quy trình có thể tiếp tục (ví dụ: tải video xuống, đăng lên mạng xã hội - các bước này không có trong JSON nhưng là logic tiếp theo).

- Nếu FALSE (video chưa hoàn thành), quy trình sẽ đi tới node

Waitđể chờ thêm một khoảng thời gian. Sau đó, nó sẽ quay lại gọi nodeGet Video1để kiểm tra lại trạng thái. Vòng lặp này đảm bảo bạn chỉ tiếp tục khi video đã sẵn sàng.

Mở rộng chân trời sáng tạo: Các ý tưởng "nâng cấp"

Khi "bộ máy" cơ bản đã vận hành trơn tru, tiềm năng là vô hạn:

- Đa dạng nguồn nội dung: Không chỉ Morning Brew, bạn có thể scrape nội dung từ blog, diễn đàn, hoặc các trang tin tức chuyên ngành khác.

- Video từ mạng xã hội: Thu thập các bài đăng, bình luận trending trên X, Reddit, Facebook và biến chúng thành kịch bản cho avatar "bình luận viên" AI của bạn.

- Cá nhân hóa hàng loạt: Tạo video chúc mừng sinh nhật, thông báo cá nhân hóa cho khách hàng từ dữ liệu CRM.

- Tự động đăng tải "A-Z": Sau khi video hoàn thành, thêm các node để tự động tải video lên YouTube, TikTok, Instagram Reels, hoặc lên lịch đăng bài qua Buffer, Hootsuite.

Những ý tưởng này không chỉ giúp bạn "x10" thời gian mà còn nhân bội sản lượng nội dung một cách thông minh. Bạn chỉ cần tập trung vào chiến lược và chất lượng kịch bản gốc.

Tự động hóa nội dung với AI clone qua HeyGen và n8n không chỉ là một bước tiến công nghệ, mà là một cuộc cách mạng trong cách chúng ta tiếp cận việc sản xuất nội dung. Từ việc "nhân bản" chính mình một cách chân thực, đến việc xây dựng những "nhà máy nội dung" tự động, phức tạp, tất cả đều nằm trong tầm tay bạn, không cần đến một dòng code.

Hy vọng những chia sẻ chi tiết từ việc "giải mã" workflow n8n của bạn sẽ là kim chỉ nam giúp bạn khởi động hành trình tự động hóa đầy thú vị này. Hãy bắt tay thử nghiệm ngay hôm nay và chứng kiến AI giúp bạn nhân lên gấp bội hiệu suất sáng tạo! Nếu có bất kỳ thắc mắc nào, đừng ngần ngại chia sẻ – tôi luôn sẵn lòng đồng hành cùng bạn.

PHÂN TÍCH & ĐỀ XUẤT CẢI TIẾN WORKFLOW

1. Tái sử dụng biến avatar_id và voice_id tự động

Vấn đề: Trong node Generate Video1, avatar_id và voice_id đang là chuỗi cố định "avatar_id" và "voice_id".

Gợi ý:

- Sử dụng node Get Avatars và Get Voices để tự động chọn avatar và voice phù hợp, thay vì mã hóa cứng.

- Thêm node Set sau mỗi node để chọn 1 avatar/voice cụ thể (hoặc ngẫu nhiên):

// Ví dụ trong Set node:

{{ $json.avatars[0].id }} // chọn avatar đầu tiên

2. Cải thiện Polling: Thêm số lần giới hạn và delay tùy biến

Vấn đề: Polling video (Get Video1 → If → Wait) hiện chạy mãi nếu video không hoàn tất.

Gợi ý:

- Thêm bộ đếm vòng lặp (Loop node hoặc Counter + IF) để tránh chạy vô hạn.

- Dùng Wait node với input dynamic từ user nếu cần điều chỉnh delay.

3. Tự động đưa script vào payload video

Vấn đề: Generate Video1 vẫn dùng đoạn văn cứng “Hey AI Automation Society Family…”

Gợi ý:

- Chuyển trường "input_text" thành script dynamic từ node Script Writer:

"input_text": "={{ $('Script Writer').item.json.text }}"

4. Tách các flow thử nghiệm (Generate Video vs Generate Video1)

Vấn đề: Hai luồng tạo video tồn tại song song, dễ gây nhầm lẫn.

Gợi ý:

- Chỉ giữ lại 1 nhánh: dùng polling (chuyên nghiệp hơn).

- Ẩn nhánh cũ hoặc tách sang một workflow khác.

5. Tối ưu hoá cấu trúc node & UI

- Gom nhóm các node vào subworkflow nếu dùng nhiều lần (VD: “Tạo Video từ Script”).

- Dùng Execute Workflow node để tách modular các phần logic.